Команда исследователей из Карнеги-Меллонского университета обнаружила доказательства, предполагающие, что сжатие данных может решать сложные задачи поиска решений без необходимости в огромном количестве предыдущих примеров. Их инновация управляет определёнными задачами распознавания шаблонов, используя только самые головоломки, что противоречит традиционным представлениям о том, как системы машинного обучения развивают навыки решения задач.

"Рынок красный? Это просто сезон скидок для умных инвесторов." - так говорят, чтобы не плакать. У нас — аналитика, которая помогает плакать реже.

Найти недооцененные активыИсаак Ляо, студент первого курса докторантуры отделения машинного обучения Карнеги-Меллонского университета, вместе с наставником профессором Альбертом Гу, ставят интересный вопрос: «Может ли одна только компрессия данных дать интеллектуальное поведение?» Их исследование кажется указывающим на возможно положительный ответ. Чтобы проиллюстрировать свою теорию, они разработали CompressARC и обширно поделились результатами на личном веб-сайте Ляо.

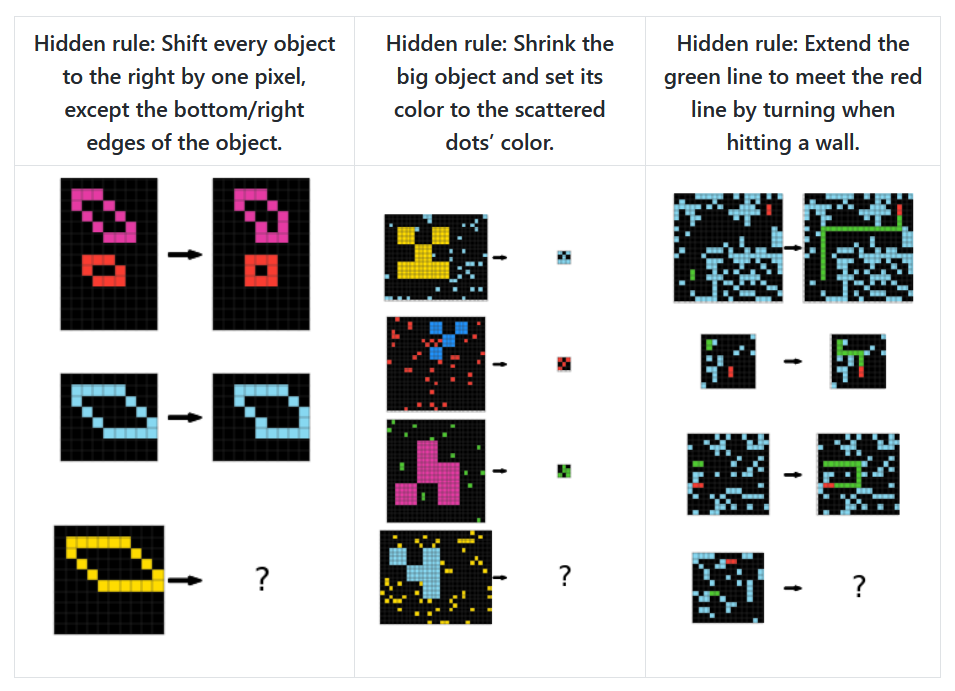

Я недавно наблюдал за парой, которая протестировала свою методологию на Abstraction and Reasoning Corpus (ARC-AGI), выдающемся визуальном стандарте, созданном исследователем машинного обучения François Chollet в 2019 году, предназначенном для оценки возможности систем ИИ абстрагировать. Этот корпус предоставляет системам визуальные задачи на основе сеток, где каждая задача содержит несколько примеров, иллюстрирующих скрый закон. Вызов заключается в способности системы вывести этот закон и применить его к новому примеру.

В качестве иллюстрации одна задача ARC-AGI представляет собой клетчатую доску, где свето-синие линии разделяют пространство на квадраты. Цель состоит в том, чтобы определить, какие цвета должны быть в каждом квадрате, исходя из их расположения: черный для углов, фиолетовый для центра и направленные цвета (красный для верхнего, синий для нижнего, зеленый для правого и желтый для левого) для остальных квадратов. Вот еще три примера задач ARC-AGI со веб-сайта Ляо:

1. Сетка с чередующимися свето-синими и темно-синими строками и столбцами. Цель — заполнить её, применяя те же правила, что были упомянуты выше.

2. Сетка, где все квадраты имеют одинаковый цвет за исключением одного квадрата в середине, который должен быть другого цвета. Задача состоит в том, чтобы выбрать цвет для этого квадрата таким образом, чтобы сетка соответствовала упомянутым правилам.

3. Сетка с двумя цветами, свето-синим и красным, но без черного или фиолетового. Здесь цель состоит в том, чтобы определить, как должны быть раскрашены квадраты на основе их позиции, чтобы соблюсти правила, упомянутые ранее.

Как я наблюдаю, эти головоломки кажется проблематизируют способности, которые некоторые исследователи предполагают, что они необходимы для искусственного интеллекта, подобного человеческому рассуждению, часто упоминаемого как «AGI» или Искусственный общий интеллект. Эти фундаментальные черты включают признание преемственности объектов, демонстрацию целеустремленных действий по отношению к целям, понимание простых арифметических операций и освоение базовых геометрических концептов — все без необходимости предварительного опыта. В среднем обычный человек удается решить 76,2% этих головоломок ARC-AGI, в то время как специалисты превосходят на 98,5%.

В декабре OpenAI создало немалый шум, объявив, что его инновационный o3 simulated reasoning model достиг небывалого результата на ARC-AGI benchmark. В тестировании при вычислительных ограничениях o3 получил 75.7%, но в тестировании с высокой вычислительной мощностью, где не было ограничений на время размышления, он достиг 87.5%. OpenAI заявляет, что эта производительность сопоставима с человеческой.

‘На наборе данных ARC-AGI, который является коллекцией головоломок, используемых для разработки системы, CompressARC демонстрирует точность 34.75 процента. Для оценочного набора, отдельной группой не виданных ранее головоломок, используемых для оценки обобщения на новые задачи, его точность составляет 20 процентов. Обработка каждой головоломки занимает примерно 20 минут с использованием потребительской видеокарты RTX 4070 GPU. Это значительно быстрее, чем ведущие методы, основанные на мощных вычислительных центрах и «космических объемах вычислений», как утверждают исследователи.’

‘Не типичный подход для ИИ’

CompressARC использует уникальную стратегию по сравнению с многими существующими AI системами, так как она не зависит от предварительного обучения, это метод, при котором модели изучают большие наборы данных перед решением конкретных задач. Вместо этого оно учится в режиме реального времени, опираясь исключительно на конкретную загадку, которую ей нужно разгадать, без необходимости использования каких-либо внешних данных для обучения.

Как аналитик, я бы перефразировал так: «Без какого-либо предварительного обучения наши модели начинают с случайных весов и учатся на данных в режиме онлайн. Уникальная задача, на которую мы фокусируемся, — это исключительно головоломка ARC-AGI, и модель генерирует один ответ по завершении.»

Когда исследователи говорят «No search», они имеют в виду другую распространенную технику решения проблем в AI, при которой системы пытаются использовать множество возможных решений и выбирают лучшее. Алгоритмы поиска работают систематическим образом, исследуя возможности—подобно шахматной программе, которая оценивает тысячи возможных ходов—вместо непосредственного изучения решения. CompressARC избегает этого метода проб и ошибок, полагаясь исключительно на градиентный спуск—a математическая техника, которая постепенно корректирует параметры сети для уменьшения ошибок, подобно тому как вы могли бы найти дно долины, всегда идя вниз.

Основная идея этой системы заключается в сжатии – обнаружении наиболее пространствосберегающего способа выражения информации путем распознавания шаблонов и повторений, что является основой ее интеллекта. CompressARC стремится найти самое краткое объяснение загадки, которое после развертывания точно воспроизводит и примеры, и решение.

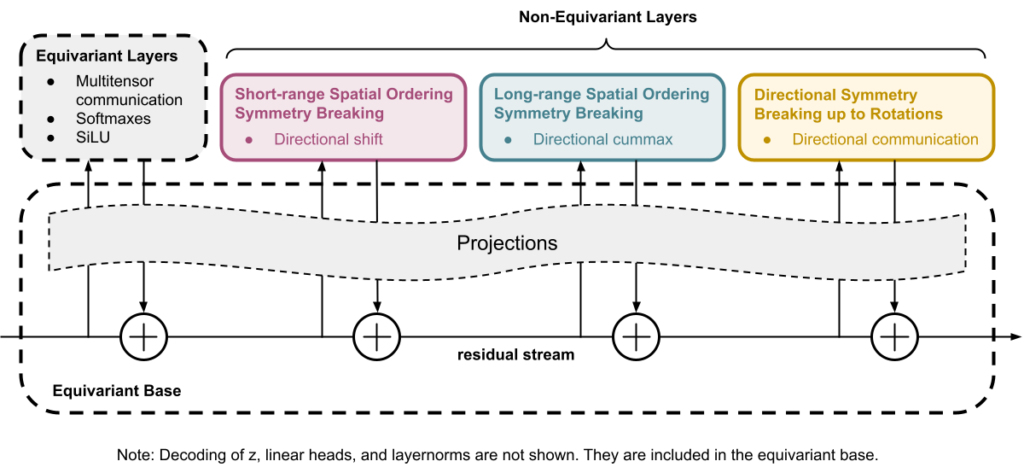

Вместо того чтобы быть моделированными под языковые модели (LLMs) или традиционные дизайны Трансформеров, CompressARC — это уникальная архитектура нейросети, разработанная специально для данной задачи сжатия. Хотя она принимает определенные структурные принципы, похожие на те, что используются в трансформерах, такие как поток резидуалов с представлениями, которые манипулируются, она не полагается на существующие LLM или стандартные модели Трансформеров.

В отличие от типичных методов машинного обучения, CompressARC использует свою нейронную сеть только как декодер. В процессе кодирования (преобразования информации в сжатый формат) система настраивает внутренние параметры сети и данные, постепенно делая небольшие корректировки для минимизации ошибок. Это создает наиболее сжатое представление, при этом правильно воспроизводя известные части головоломки. Эти оптимизированные параметры затем становятся сжатым представлением, которое хранит головоломку и её решение в эффективном формате.

Согласно исследователям, основная проблема заключается в поиске сжатой версии информации без необходимости иметь решения как ввод. Простыми словами, они используют компрессию в качестве способа делать образованные догадки.

Этот метод может быть полезным в областях, где нет доступа к обширным наборам данных или когда необходимо для систем быстро адаптироваться к новым обязанностям, используя только несколько примеров. Исследование подразумевает, что определенные типы интеллекта могут возникать не из запоминания шаблонов на основе больших объемов данных, а из эффективного сжатия информации в компактные формы.

Связь сжатия-интеллекта

Идея о том, что может существовать связь между сжатием данных и интеллектом, изначально может показаться необычной, но на самом деле основывается на глубоких принципах теории вычисления, таких как сложность Колмогорова (самая короткая возможная программа или код, который генерирует определённый результат) и индукция Соломонова – теоретический идеал для прогнозирования, аналогичный оптимальному методу сжатия данных.

Чтобы эффективно сжать данные, система должна идентифицировать паттерны, повторения и уловить основную структуру — способности, часто связываемые с интеллектуальными действиями. Система, которая может предвидеть будущие элементы в серии, может эффективно сжать эту последовательность. Следовательно, многие компьютерные учёные на протяжении лет предложили, что сжатие может быть синонимичным общему интеллекту. Следуя этим принципам, Hutter Prize вручал награды исследователям, которые могут минимизировать файл размером 1ГБ до его наименьшего возможного размера.

В сентябре 2023 года мы обсуждали тему интеллекта и компрессии данных. Это было, когда научная статья DeepMind показала, что большие языковые модели могут превзойти некоторые специализированные методы компрессии. В этом исследовании ученые обнаружили, что модель Chinchilla 70B от DeepMind может сжать фрагменты изображений до 43,4% от их первоначального размера, превосходя PNG’s 58.5%. Кроме того, она смогла уменьшить аудиопробы только до 16,4%, превышая коэффициент компрессии FLAC’а 30,3%.

Исследование 2023 предложило сильную связь между сжатием данных и интеллектом – понятие, что эффективное расшифровывание шаблонов приводит к более эффективному сжатию, что соответствует последнему исследованию CMU. В отличие от демонстрации DeepMind способностей по сжатию в существующей модели, работа Ляо и Гу рассматривает свежий подход, показывая, как процесс сжатия может порождать интеллектуальное поведение с нуля.

Как аналитик, изучающий область искусственного интеллекта, я нахожу это новое исследование особенно интересным, поскольку оно оспаривает широко принятые подходы в развитии ИИ. Традиционно развитие ИИ опирается на колоссальные предварительные наборы данных и вычислительно затратные модели. Однако CompressARC предлагает уникальную концепцию: интеллект возникающий из фундаментально различного принципа. В то время как крупные игроки в области ИИ неустанно двигаются к более крупным моделям, обученным на огромных наборах данных, CompressARC предлагает альтернативную точку зрения.

В своих выводах исследователи предполагают, что интеллект CompressARC не основан на предварительной обучении, больших данных, тщательных поисках или значительных вычислительных ресурсах. Вместо этого он проистекает из сжатия. Они ставят под вопрос традиционную зависимость от обширного предварительного обучения и данных, и предлагают будущее, где используются конкретные сжимающие цели и эффективное вычисление во время инференса для извлечения глубокого интеллекта из небольших объемов вводных данных.

‘Ограничения и взгляд в будущее’

Несмотря на свои достижения, система Ляо и Гу имеет очевидные ограничения, которые могут вызвать сомнения. В то время как она отлично справляется с задачами, связанными с распределением цветов, заполнением, обрезкой и опознанием близлежащих пикселей, ей трудно с такими задачами, как подсчет, распознавание далеких узоров, вращения, отражения или имитация поведения агента. Эти ограничения предполагают, что базовые принципы сжатия могут не полностью подходить для этих случаев.

Исследование еще не прошло оценку специалистами, и хотя достижение 20% точности на нерешенных головоломках заслуживает похвалы без предварительной подготовки, важно отметить, что это производительность значительно уступает как человеческим способностям, так и лучшим системам ИИ. Некоторые скептики могут сомневаться в том, использует ли CompressARC уникальные структурные шаблоны в головоломках ARC, которые могут плохо переноситься на другие области. Это вызывает сомнения в том, может ли только сжатие составлять прочную основу для общего интеллекта, как и быть лишь одной частью головоломки многих необходимых компонентов для надежных способностей решения проблем.

По мере быстрого развития технологии ИИ CompressARC, если он окажется надежным, может раскрыть интересный альтернативный путь создания интеллектуального поведения, который не требует обширных ресурсов, используемых сегодняшними методами. В любом случае, он может выявить ключевой аспект общей машинной интеллигентности, который по-прежнему остается в значительной степени загадочным.

Смотрите также

- 6 лучших планшетов для путешествий в 2024 году

- Я думал, что этот Android-телефон за 250 долларов станет катастрофой. Это не было

- Я нашел идеальный аксессуар для ношения моего iPhone 16 Pro Max

- Я рассмотрел два лучших менеджера паролей. Вот тот, который я рекомендую людям использовать

- Onyx Boox Palma 2 — гаджет, о котором я даже не подозревал

- Настоящая поддержка Markdown появится в Google Docs не раньше, чем сейчас.

- Я носил часы, которые производились 50 лет. Вот почему это так особенно

- Обзор KTC M27P6 27-дюймового 4K Mini-LED: Производительность и соотношение цены и качества, с которыми трудно соперничать.

- Фанаты LOTR неправы насчет магии в Средиземье

- Onyx Boox Palma — самый крутой гаджет, который я использовал в 2024 году.

2025-03-07 04:34